- Dettagli

Pipeline modificata OpenGL con Map Reduce e MPI

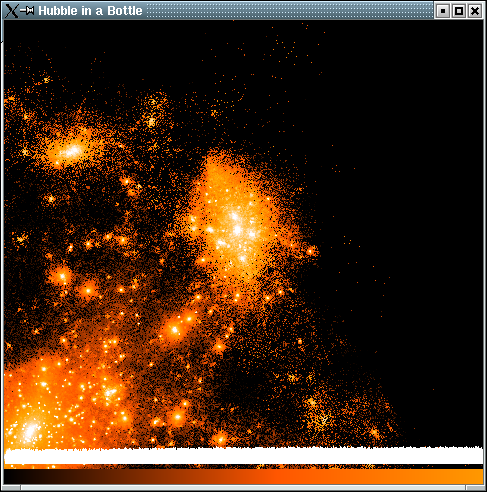

Hubble in a bottle! era un tool di visualizzazione scientifica per file TIPSY con molte ottimizzazioni (3dnow per i processori AMD e SSE per Intel) e la proprietà di poter girare su un grande supercomputer di tipo Beowulf usando la libreria MPI. Le versioni iniziali sono state sviluppate da Tiziano nel 2003 ed includono una pipeline grafica modificata e una versione parallela con MPI. Thomas Kühne ha di gran lunga migliorato il tool sia dal punto di vista teorico che da quello pratico pubblicando il suo lavoro di diploma, ed ha portato il codice a livello produttivo nel 2005 all'Istituto di Fisica Teorica dell'Università di Zurigo sul supercomputer zBox costruito da Joachim Stadel. Thomas lavora attualmente come professore di chimica teorica a Paderborn.

L'utilità di Hubble in a bottle è diminuita dai progressi fatti con le carte grafiche multiuso di ultima generazione (GPGPUs). Clicca qui per vedere la pagina di progetto su Sourceforge.

Le stelle di Hubble in a Bottle possono essere ruotate intuitivamente in tempo reale usando i quaternioni. Tre modalità di plot sono disponibili: densità massima, stella più vicina e approssimazione su linea di vista, se il file di densità manca. Ci sono dieci mappe di colori ed un filtro Sobel per evidenziare i contorni. Il progetto è Open Source ed è rilasciato sotto licenza GPL.

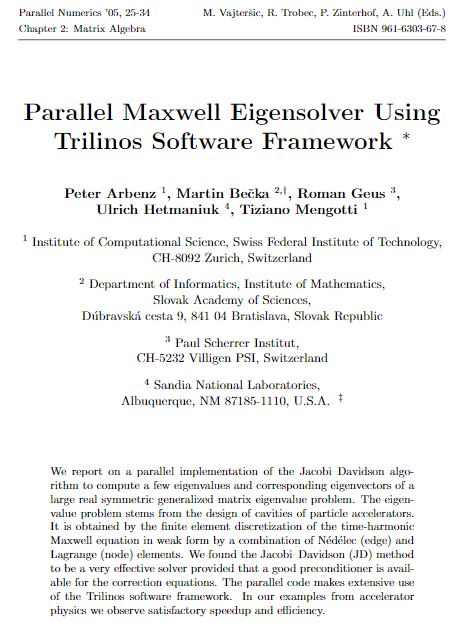

Elementi Finiti col Framework Trilinos

Nel semestre invernale del 2004, Tiziano ha lavorato con altri sviluppatori software per portare il codice di FEMAXX scritto da Roman Geus da Python al C++ del framework Trilinos sviluppato da Sandia National Labs. Il gruppo ha poi pubblicato il paper scientifico On a parallel multilevel preconditioned Maxwell eigensolver. Copiando alcune routines da Epetra_CrsMatrix.cpp a LocalCrsMatrix.h per fare alcuni tests, Tiziano ha notato un baco alquanto severo in Trilinos: la trasposizione multivettoriale del metodo risolutore che usa la matrice triangolare inferiore era sbagliata. Un semplice patch è stato allora mandato al team di Trilinos. Il baco è poi stato consolidato e risolto qui.

Certificato di lavoro ETH

Introduzione al Calcolo Parallelo

Un buon libro di introduzione al calcolo parallelo è quello del professor Wesley P. Petersen:

- Dettagli

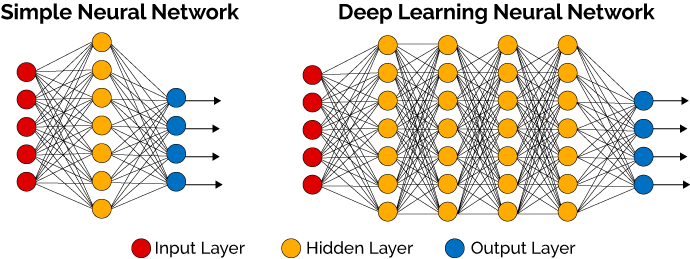

Semplici Reti Neurali esistevano già negli anni '80 del secolo scorso. I nuovi sviluppi dell'ultimo decennio sia con nuovi algoritmi di Backpropagation per l'allenamento sia con l'avvento delle carte grafiche a scopo generale (GPGPU, General Purpose Graphics Processing Units) permettono ora di utilizzare Reti Neurali molto più grandi. Esse sono il fondamento del campo di ricerca chiamato Deep Learning.

Il Cluster di Calcolo di deep space computing AG è il candidato ideale per allenare Reti Neurali di tipo Deep Learning.

Qui trovate la presentazione "Einführung ins Deep Learning", che abbiamo presentato all'Asset Optimization Day 2019 a Berna.

Pagina 3 di 3